今週、 Google マップは新しいマップ ライブ ビュー拡張現実ナビゲーションのテストを開始しました。この新機能により、環境内でカメラを向けているときに指示矢印を見ることができます。

Google マップでのカメラの使用は、 ARCore拡張現実で段階的なナビゲーションの矢印をペイントすることに限定されず、カメラを別のセンサーとして使用して位置を改善することもできます。

グローバルロケーション

近年、Google は GPS とコンパスを使用して Google マップの青いドットの精度を向上させようと努めてきましたが、両方のセンサーの物理的な制限により、特に都市環境では最高の精度を提供することが困難になっています。

この問題を解決するために、彼らは現在、新しい (VPS)、ストリート ビュー、および自動学習を組み合わせてモバイルの位置と方向をより正確に識別するGlobal Locationの実験を行っています。

GPS は都市環境、特に高層ビルがある場所では不十分です。衛星信号は建物で反射するため、携帯電話の位置情報が実際の位置から数メートル離れてしまい、別の通りにいることさえあります。

また、GPS は、私たちが見ている場所の方位を判断することができません。この欠点を補うために、モバイル デバイスのコンパスが使用され、地球の磁場と重力場、およびデバイスの相対運動が測定されます。これらのセンサーは、車、パイプ、建物などの環境内の磁性物体や、電話自体の内部の電子機器によって簡単に偏向されます。場合によっては、最大 180 度の誤差が発生することがあります。

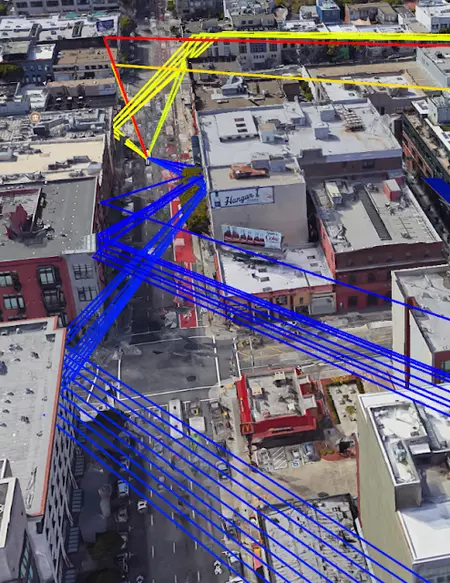

GPS とコンパスのこれら 2 つの制限を考慮して、Google はこれら 2 つのセンサーに携帯電話のカメラを追加する新しい補完技術をテストしています。新しいGoogle マップ ライブ ビューは、新しい Visual Positioning Service のおかげで、標識ではなく画像のみに基づいて位置を特定できるようになります。携帯電話で撮影した画像は、ストリートビューでその地域を撮影した画像と分析され、機械学習アルゴリズムにより、デバイスの位置をより正確に判断し、人々を目的地まで案内できるようになります。

この手法を使うと、その瞬間に撮影された画像とストリートビューで撮影された画像が異なる可能性があるという問題もあります。看板や木など、時間の経過とともに変化する要素があります。これを行うには、機械学習が建物などのシーン内の永続的な構造に焦点を当てることを学習する必要があります。

詳細情報 | グーグル