携帯電話での写真撮影が大きく進化していることは、現在のスマートフォンを試した後、数年前のスマートフォンに戻るだけでもわかります。そして、それはカメラの数だけでなく、画像の処理方法、特に背景のぼかしやボケなど、携帯電話の処理能力を利用する非常に特殊なタイプのキャプチャでも顕著です。俗にポートレートモードと呼ばれるもの。

Google は Android でポートレート モードを表しており、Pixel を持っている人なら誰でもこれを知っています。また、他のスマートフォンに適合したGcam または Google カメラを試したことがある人もいます。このカメラで得られる背景のぼかしは非常に自然であるだけでなく、 後から Google フォトで調整することもでき、画像を大幅に向上させるトリミングを実現します。しかし、Google はどのようにしてそれを達成しているのでしょうか?同社が説明した。

Pixel 4のデュアルカメラは重要です

Google Pixel 4 の最初の噂が出たとき、同社は前面カメラ ( Google Pixel 3 ) で非常に良い結果を得た後、最終的に複数の背面カメラを採用することを決定したため、私たちは皆満足しました。確かに、新しい Pixel には広角光学系は含まれていません。望遠に賭けるというのは、かなり奇妙に思えた。しかし、背景がぼやけているという説明があります。

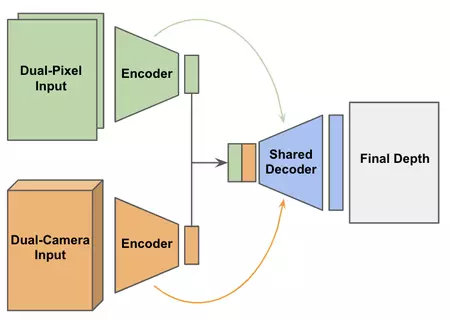

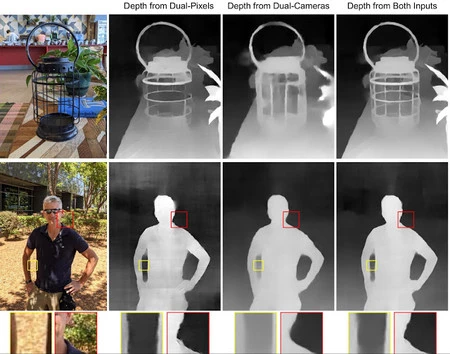

Google は、 ブログの記事で、Google Pixel 4 のボケ効果をどのように改善したかについて説明しました。その鍵は、背面カメラのデュアル ピクセル システムと、それぞれのレンズに 1 対のセンサーを搭載しているという事実にあります。カメラから提供される情報のおかげで、システムはオブジェクトの奥行きを正確に識別し、前景に自然にトリミングを適用できます。画像に適用された人工知能は、機械学習のおかげでエッジを正確に区切って、実際の光学系(プロ仕様のカメラに搭載されているもの)を模倣してぼかし効果を適用するため、これに貢献しています。

カメラのデュアル ピクセル システムにより、オブジェクトに正確に焦点を合わせることができ、背景からオブジェクトを切り取ってぼかしを適用することもできます。また、Pixel 4 には 2 つのカメラが搭載されているため、Google は取得した 2 つの画像を対比させることで視差効果を実現しています。これにより、 AI が前景と背景の変化を検出します。トリミングを正確に適用できるようになります。

AI、デュアル カメラ、デュアル ピクセル センサー システムの利用に加えて、 Google はレフレックス カメラ (SLR) から取得した実際のブラー モデルを使用して、機械学習後にさまざまなポートレート モード効果を適用します。これにより、より自然になるだけでなく、プロフェッショナルに見える結果も得られます。また、HDR+ 画像の処理が改善され、背景の彩度とコントラストを前景のオブジェクトの彩度とコントラストに適応させます (トーン マッピング)。

ポートレート モードで導入されたすべての改良点は、Google Pixel 4 で利用できるようになりました。デュアル カメラが必要なため、以前の Pixel ではこれらの機能を楽しむことができませんでしたが、それでも、背景のぼかしの優れた品質を維持しています。 Gcam も優れています。Google が画像の処理方法を知っていることに疑いの余地はありません。

詳細情報 | グーグル