Google レンズについては、 2017 年 5 月に Google I/O カンファレンスで発表されて以来知っていました。これは、人工知能を使用した画像認識サービスで、撮影しているものに関する追加情報を提供します。さあ、 Google ゴーグルのようなものですが、現在の時代に適応しています。

ここで、それが Google エコシステム全体にどのように広がるのかをもう少し見てみましょう。 1 か月前にはGoogle フォト経由で初代 Google Pixel にアクセスできましたが、今日では 2 番目にアクセスできる場所であるGoogle アシスタントにアクセスし始めています。もちろん、これは依然としてPixel スマートフォンの独占的な機能です。

文章も音声も映像も

当初、Google アシスタントとは音声でのみ通信できました。「OK、Google、これをして」、「OK、Google、これをして」。その後、テキスト、つまり書き込みを介したインタラクションが登場しました。現時点では、アシスタントと対話する方法として画像を採用することで、それが一巡します。

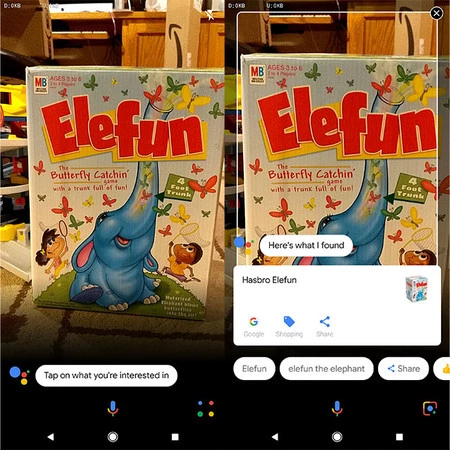

一部のユーザーは、Google アシスタントの新しいボタン、レンズ ボタンを見つけました。これを押すとカメラが開き、すでにご存知のとおり、カメラはリアルタイムで画像認識を使用して、見ているものに関するあらゆる種類の情報を提供します。

ボタンを押すとカメラが開き、追加情報を取得したいオブジェクトをタップする必要があります。 Google レンズがそれを認識すると、フローティング カードに情報が表示され、必要に応じて追加のアクションが表示されます。

今のところ、Google アシスタントへの Google レンズの導入は第 1 段階にあるようで、これを有効にしているユーザーはほとんどいません。この機能はまだ公式にはPixel専用ですが、Googleアシスタントの場合と同様に、最終的には他の携帯電話にも普及する可能性が高いです。

経由 | アンドロイド警察

ザタカ Android | Google レンズが写真を通じて最初のピクセルに到達し始める