Google は何よりもソフトウェア開発会社であり、特に機械学習、つまり人工知能に基づいた製品に関連しています。携帯電話 (独自のまたは Android エコシステム) やパーソナル アシスタントなどの物理的な製品は、実際にはAI の進歩を実証するためのサポートであるようです。

したがって、マウンテン ビュー チームは、過度の個人情報を含まずに、その機能や動作方法を随時公開することを躊躇しません。 ポートレート モードを適用するためにレイヤーを読み取る方法や、 私たちが口ずさむ曲を認識するために音声を処理する方法はすでにわかっています。ここで写真の分野に戻り、Pixel カメラ アプリによって生成される人工光である「ポートレート ライト」がどのように機能するかを Google に教えてもらいます。

Pixel「ポートレートライト」の仕組みはこうだ

Google自身が述べているように、この人工的な「ポートレートライト」はPixel 4、Pixel 4 XL、Pixel 4a、Pixel 4a 5G、Pixel 5のカメラにすでに搭載されており、撮影した写真の照明を変更できるようになります。予想どおり、これは人工知能と連携した写真レタッチのモードであり、Google はそれがどのようにして前述の効果を開発したかについて説明しています。

「ポートレート ライト」写真モードは、 Light Stageと呼ばれる計算照明システムでトレーニングされており、写真への指向性ライトの自動配置と、写真が撮影された後の再照明の両方を可能にします。

Google によると、Light Stage をトレーニングするために、さまざまな視点に配置された 64 台のカメラを備えたセットで、個別にプログラム可能な 331 個の LED 光源を使用して、何千人もの個人を撮影したそうです。したがって、Google の AI は、一度に 1 つの光で各個人を撮影することで、複数の照明環境で合成ポートレートを生成し、それらを使用してトレーニングすることができました。

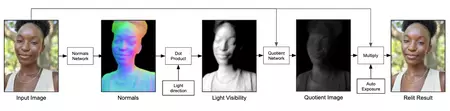

ライブまたは遡及的にシーンを照明するために、Pixel カメラは機械学習を使用して、撮影している写真に最も適した照明プロファイルを推定します。 Google のカメラの背後にある AI は、シーン内の各光源の方向、相対強度、色、および撮影時の頭の姿勢を評価します。

したがって、 Google は、合成的に生成された光の理想的な状況を推定し、それを事実上シーンの外に配置し、実際には存在しないが、写真スタジオの実際の光とほとんど区別できない光と影を撮影対象の人物に生成します。

64 台のカメラと 331 個の独立したプログラム可能な光源で撮影された何千人もの個人が AI を訓練しました

Google の AI の利点は、「ポートレート ライト」モードがすでにリリースされ、完全に動作すると、撮影する写真ごとにトレーニングを継続できることです。ステージの後ろに隠された AI も、シーンの認識に役立つ幾何学的モデルを使用して照明の細部を監視します。一度キャプチャされたシーンは完全に平坦であり、Google は光を使って遊び続けるためにそれを 3 次元的に再構築することに注意してください。このシステムは、ぼかしに適用するレイヤーを分離するために使用されるものと似ています。

Google は、Stage Light システムでトレーニングされた「ポートレート ライト」を、携帯電話ですでに撮影された写真に対するクリエイティブな照明制御への第一歩にすぎないと考えています。したがって、マウンテン ビュー チームの機械学習は今後も進化し続け、現在のものよりもはるかに効率的な後方照明モードが少しずつ得られることが予想されます。

詳細情報 | グーグル